SERVICIOS

GarantIA

Gobierno y Gestión del Ciclo de Vida de IA - Evaluación y Auditoría de IA.

La Inteligencia Artificial (IA) ha experimentado en los últimos años un gran avance en su aplicación y visibilidad tanto en el plano social, como empresarial. En particular, en el último lustro ha sufrido un desarrollo vertiginoso, desmesurado y, hasta cierto punto, descontrolado, que ha desembocado en un complejo escenario a nivel social, económico, industrial y tecnológico, debido a la afectación directa de la IA sobre factores ligados con los derechos fundamentales de los ciudadanos en relación a la discriminación (sesgos y equidad), la privacidad o la usabilidad, sin la adopción de las medidas necesarias para garantizar los mismos relativas a la transparencia, la interpretabilidad, la explicabilidad, la ética, la responsabilidad, la fiabilidad, la seguridad, la robustez, la trazabilidad o la auditabilidad, amén de otras deseables como la sostenibilidad. Esto ha desembocado en un clima de incertidumbre y recelo social hacia la IA. En un intento de responder a estas demandas y avanzar hacia el desarrollo y uso de una IA confiable, responsable y transparente, la Unión Europea ha desarrollado, y puesto en vigor en agosto de 2024 el Reglamento de IA (Reglamento (UE) 2024/1689) (Ley de IA, en adelante), con un calendario de aplicación progresivo hasta agosto de 2027, en el que establece un marco normativo estricto que afecta a todos los proveedores y usuarios (agentes, en adelante) relacionados con la IA (p. ej. proveedores, desarrolladores o distribuidores), en función de un nivel de clasificación del riesgo de IA (inaceptable, alto, limitado, y mínimo), que tiene relación directa con ciertos usos y actividades (p. ej. identificación o puntuación social) o determinadas áreas/sectores relevantes (p. ej. sanidad, empleo, justicia o educación), estableciendo diversos niveles de cumplimiento.

De esta forma, sea por la presión social y/o por el cumplimiento normativo, las organizaciones que operen con IA deben poner en marcha las medidas adecuadas (técnicas y organizativas) que correspondan, orientadas a garantizar una IA confiable, transparente y responsable. Sin embargo, los requerimientos para logarlo no son, ni pocos, ni sencillos, debiendo abordar ámbitos heterogéneos y complejos (p. ej. gestión de riesgos, seguridad, supervisión humana, calidad, gestión del cambio, seguimiento y supervisión continua, alfabetización, incidencias, gobernanza de los datos, certificación, gestión de la documentación, gestión de inventario, evaluación de la conformidad o auditorías).

Mención especial requiere la interpretabilidad (que no explicabilidad) de los modelos de IA, como mecanismo nuclear habilitador de la transparencia y, por ende, de la responsabilidad y la confiabilidad de la IA. De esta forma se impone la necesidad de incorporar modelos centrados en la interpretabilidad inherente (intrínseca o “ante-hoc”) en los sistemas de IA. Las empresas que operan como agentes en distintos roles con sistemas de IA y en distintos sectores críticos afectados, y tienen, por tanto, la necesidad de poner en marcha estos mecanismos, amén de considerar su adopción como una oportunidad de negocio estratégica, lo que da pie a la definición de este proyecto.

De cara a la implementación práctica de lo requerido por la ley, existen algunas normas y estándares relacionados que pueden ayudar a las empresas en la implementación de la Ley, como es el caso de:

-

ISO/IEC 42001:2023 en el ámbito de los Sistema de gestión de IA

-

ISO/IEC TR 24028:2020 en el ámbito de la Confianza en sistemas de IA

-

ISO/IEC 23894:2023 en el ámbito de la Gestión del riesgo en IA

-

ISO/IEC TR 24027:2021 en el ámbito de los Sesgos en sistemas de IA

-

ISO/IEC 5259‑1/3/4:2024 en el ámbito de la Calidad de datos para IA

-

ISO/IEC 24030:2024 en el ámbito de Casos de uso de IA

-

ISO/IEC TR 24368:2022 en Aspectos éticos y sociales

-

ISO/IEC 5469:2024 en el ámbito de la Seguridad funcional en IA

-

NIST AI RMF como Marco de Gestión de Riesgos de IA de NIST

-

IEEE 7000‑2021 como estándar de proceso ético para diseño

-

Otras series ISO/IEC de interés son:

-

ISO/IEC 5339:2024 Artificial intelligence Guidance for AI applications

-

ISO/IEC 8183:2023 Artificial intelligence Data life cycle framework

-

ISO/IEC 5338:2023 Artificial intelligence AI system life cycle processes

-

ISO/IEC TR 24368:2022 Artificial intelligence Overview of ethical and societal concerns

-

ISO/IEC TS 4213:2022 Artificial intelligence Assessment of ML classification performance

-

ISO/IEC 24668:2022 AI Process management framework for big data analytics

-

ISO/IEC 23053:2022 Framework for Artificial Intelligence (AI) Systems Using ML

-

De manera adicional existen algunos estándares para ámbitos específicos, como la ISO 26262 para la automoción o la ARP 4761, la DO-178C y la DO-254 para la industria aeroespacial, que cubren algunos aspectos de los requisitos de la Ley para los sistemas de IA de alto riesgo. En otro orden de cosas, los modelos de calidad para productos de IA, como la norma ISO/IEC 25059:2023, pueden ayudar a abordar los requisitos establecidos en la Ley en las primeras fases del ciclo de desarrollo. Además, proporcionan la flexibilidad para incluir los atributos que pueden no ser relevantes para la seguridad, pero que garantizan una mejor calidad.

En lo que se refiere a la Auditoría de IA, uno de los aspctos más relevantes del ciclo de Vida de IA, sin duda, una referencia de interés es la propuesta del Institute of Internal Auditors (IIA) que publicó su libro Global Perspectives and Insights, Artificial Intelligence – Considerations for the Profession of Internal Auditing, en el que proponen considerar la Auditoría de la IA bajo los tres componentes generales de la gobernanza, la estrategia y el factor humano. La orientación del IIA proporciona ejemplos de procedimientos y áreas de investigación que las funciones de auditoría interna podrían utilizar como punto de partida para auditar los elementos clave que se incluyen en estos tres componentes. Otros trabajos de interés a tener en cuenta son: COSO’s Enterprise Risk Management (ERM); U.S. Government Accountability Office AI Framework; Singapore PDPC Model AI Governance Framework; ITechLaw Responsible AI Global Policy Framework; ICO Guidance on AI and data protection; Artificial Intelligence and Data Act (AIDA) of the Government of Canada; The Hourglass Model of Organizational AI Governance; ASEAN Guide on AI Governance and Ethics; ECP AI Impact Assessment; GAO Accountability Framework for Federal Agencies and Other Entities.

Sin embargo, estas propuestas, en su estado actual, no abordan en muchos casos consideraciones específicas de la IA para la seguridad, la transparencia y la supervisión humana, y en todo caso ninguna de ellas actúa como marco global que permita cubrir todos los procesos involucrados que deben ser cubiertos. Si bien sirven de apoyo como base sobre la que trabajar, no pueden ser utilizadas de manera exclusiva, lo que motiva, una vez más el desarrollo del proyecto que se propone.

En este contexto, AuditAI ha desarrollado GarantIA, sistema tecnológico novedoso y avanzado, inexistente hasta la fecha, tanto en el panorama nacional como internacional, empresarial o científico, que permite a las empresas y a sus agentes abordar de manera práctica todos los requerimientos que establece la Ley de IA, amén de otros que demande la sociedad. Si bien existen aproximaciones a modo de propuestas tipo estándares (ISO, IIA, etc.) estos son parciales (p. ej. auditoría o gestión de riesgos) y en ningún caso con un enfoque práctico como el que AuditAI plantea, a modo de sistema instrumental que cubre todo el ciclo de vida.

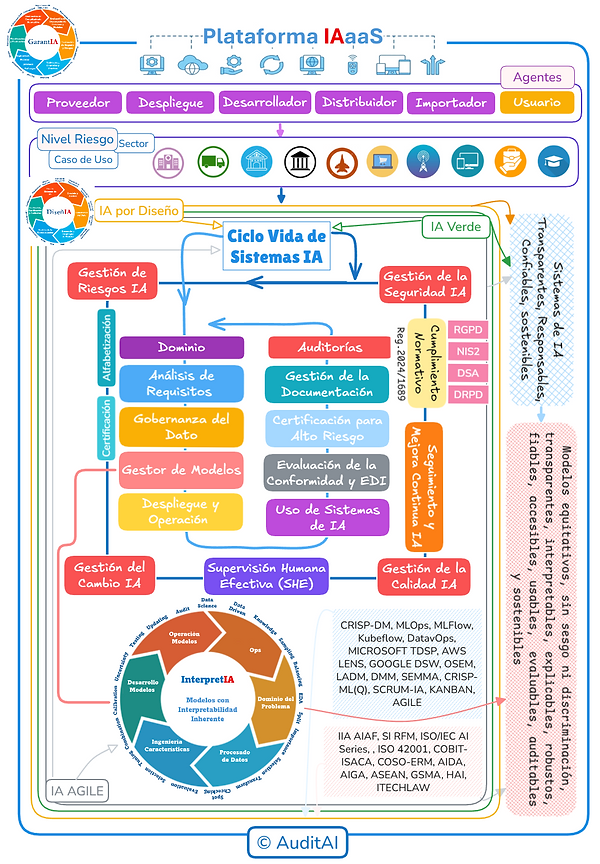

El sistema, que se representa en la figura, se diseña para que imprima un enfoque de IA por Diseño en el “ADN” de los sistemas de IA, desde su concepción y desarrollo, hasta el uso de los mismos. A su vez, utilizará para su operación un enfoque “IA AGILE” que permitie, entre otros, la alineación con el negocio mediante entregas de valor tempranas, por fases y procesos.

Todo ello se plasma en un marco de actuación práctico y operativo diseñado ad-hoc (DiseñIA) que opera con un Ciclo de Vida de Sistemas de IA a modo de orquestador de los procesos incrementales definidos, tanto los procesos esenciales que actúan como pilares fundamentales (Gestión de Cumplimiento Normativo, Gestión de Riesgos IA, Gestión de la Seguridad, Supervisión Humana Efectiva, Gestión de la Calidad IA, Gestión del Cambio IA y Seguimiento y Supervisión Continua), como los procesos operativos (Identificación del Dominio; Análisis de Requisitos Exigibles; Gobernanza del Dato; Gestor de Modelos; Despliegue y Operación; Uso de Sistemas de IA, Evaluación de la Conformidad y EDI; Certificación para Alto Riesgo; Gestión de la Documentación, y Auditorías), amén de otros como los relativos a la sostenibilidad. Estos procesos cubren todos los requerimientos establecidos y necesarios para abordar una IA acorde a la ley.

Concretamente, cuenta con un proceso a modo de Gestor de Modelos que, a través de un conjunto de instrumentos ad-hoc, (p. ej. InterpretIA - Desarrollo de Modelos con Interpretabilidad Inherente o un Selector de Modelos por niveles de Interpretabilidad/Explicabilidad/Riesgo) permitirá a los distintos agentes abordar la selección, desarrollo o uso adecuado de modelos, con foco en modelos con interpretabilidad inherente.

Todos y cada uno de estos procesos se habilitan a modo de instrumentos prácticos, tanto técnicos (herramientas, módulos y funcionalidades software) como procedimentales (políticas, procedimientos, controles, guías, modelos de madurez, SLAs, etcétera), a modo de componentes en la plataforma, en un proceso guiado (flujo de operación) y particularizado (perfiles) por agente, sector o caso de uso, que permitirán a una empresa adaptarse a la Ley de IA íntegramente.

El diseño y desarrollo del sistema y de todos y cada uno de los procesos está basado en los marcos de actuación (estándares, normas, buenas prácticas, etc.) más representativos y utilizados en la actualidad, como las series ISO/IEC (42001:2023, TR 24028:2020, 23894:2023, 24027:2021), IIA Frameworks, COSO-ERM o NIST AI RMF.

En el plano técnico, el sistema se puede materializa a modo de Plataforma Cloud en modo “IAaaS” en el ecosistema de la empresa de forma que permite dar servicios a partir de un acceso categorizado, en primera instancia por niveles acordes a los distintos roles o agentes intervinientes (desarrollador, proveedor, etc.) y, en segunda instancia, por nivel de riesgo/sector/caso de uso, en función de lo que se particularizará el flujo de operación, así como los procesos a operar, en cada caso.